Человек против чат-бота: еще одна грань информационных войн

Искусственный интеллект, по оценкам экспертов, может вдвое увеличить объем мировой экономики в следующие 10 лет. Однако, к сожалению, активно его используют не только в бизнесе, но и для информационной агрессии в сети в рамках социально-политического инжиниринга. Как отличить живого "тролля" в соцсетях от чат-бата и что с этим делать дальше — рассказывает политический психолог, кандидат психологических наук Наталия Красовская.

— Сегодня в разработку технологий на основе искусственного интеллекта вкладываются миллиарды долларов, и довольно значительная доля этого финансирования идет со стороны государства. Причем в первую очередь, конечно, госсектор интересуется возможностями ИИ в сфере нацбезопаности в целом и кибербезопаности в частности. Национальные стратегии развития искусственного интеллекта разработали уже более 30 стран. Можете доступно объяснить нашим читателям, с чего начался этот скачок интереса и что рассчитывают получить правительства стран в итоге?

— Действительно, сегодня искусственный интеллект — это очевидный мировой тренд в развитии технологий. Наиболее плотно ИИ сейчас используется в финансовом секторе. Благодаря возможности обрабатывать огромный объем данных и анализировать информацию, ИИ с успехом используют для расследования мошенничества, проверки документов на ошибки, прогнозирования развития рынков и т. д.

Например, Россия входит в Топ-5 стран мира, которые пользуются ИИ для установления платежеспособности клиента. ИИ может проанализировать соцсети клиента: определить, примерную стоимость предметов, запечатленных на выложенных в общий доступ фото, посчитать как часто клиент ездит в отпуск, какие покупки совершает — и дать заключение о его примерных тратах и благонадежности.

Плюс — автоматизированная служба поддержки клиентов, с которой сталкивался каждый из нас, кто звонил хоть раз в службу поддержки или пользовался банковским приложением на смартфоне. Государство также не отстает от бизнес-сегмента в этом аспекте — сегодня, если вы звоните в любое госучреждение, то скорее всего сталкиваетесь с "виртуальным помощником". И только если вы не находите ответа в предложенном перечне, вас переключают на живого человека. По некоторым данным, мировой рынок чат-ботов и виртуальных ассистентов каждый год увеличивается примерно на треть, в прошлом году он составил около двух миллиардов долларов.

Важно также понимать, что государство задействует возможности искусственного интеллекта и в процессе обеспечения кибербезопасности. Тем не менее существующие сегодня модели и алгоритмы при всем умении обрабатывать информацию, крайне ограничены в способности делать выводы. ИИ сегодня — продвинутый, высокотехнологичный, но всего лишь инструмент, которым должен работать человек. И все усилия государств сейчас направлены на совершенствование этого инструмента.

— Давайте подробнее остановимся на вопросах безопасности в киберпространстве. У этого термина — в глобальном аспекте — сегодня нет какого общепринятого определения. Что подразумеваете вы, когда упоминаете кибербезопасность?

— Не секрет, что многие технологии подвигающие человека на приобретение товара или услуги, которые сейчас широко используются рекламщиками и маркетологами, изначально разрабатывались как средства манипуляции человеческим сознанием в военных целях.

Бот-чаты, которые сегодня повсеместно внедряются бизнесом и госучреждениями для выстраивания коммуникации с клиентами, так же имеют свою "темную" сторону. Они весьма успешно используются в рамках социально-политический инжиниринга. Другими словами, их успешно используют агенты влияния для формирования нужных другой стороне общественных мнений и побуждения к совершению поступков, направленных на дестабилизацию внутри политической ситуации в стране, попавшей в поле интересов агрессора.

Приведу интересный факт. В прошлом году американский президент Дональд Трамп подписал указ, призванный вдвое ускорить реализацию проектов в области искусственного интеллекта. А на следующий день Министерство обороны США опубликовало свою стратегию развития ИИ, в том числе на базе специального Объединённого центра искусственного интеллекта (JAIC), бюджет которого только в 2019 году составлял 90 млн долларов. В то же время Россия, по данным аналитиков, инвестировала в развитие ИИ 172,5 млн долларов, доля государственного финансирования составила всего 6% — т. е. немногим более 10 млн долларов. Другими словами, государственные вложения США только в один проект оказались в 9 раз больше, чем траты России на всю сферу. Наверное, неслучайно в глазах экспертов, Америка заслужила репутацию государства, ведущего крайне агрессивную политику в информационном пространстве.

— Можете привести примеры, когда искусственный интеллект использовался для совершения информационных атак?

— Думаю, что такие примеры может привести каждый пользователь социальных сетей — из собственного опыта. Например, недавние событие в Белоруссии сопровождались огромным количеством разной степени цензурности дискуссий в интернет-пространстве.

- С одной стороны, живое общение и обсуждение самых актуальных вопросов — это как раз то, ради чего соцсети и создавались.

- Но с другой, такая свобода одновременно является и слабостью, которую стороны успешно используют для дезинформации и пропаганды в ходе информационных войн.

В 2017 году Facebook впервые признал тот факт, что "различные "неправительственные агенты", а также властные структуры используют соцсеть для влияния на умы пользователей". Facebook начал блокировать неподтвержденные аккаунты: только за 2019 год они удалили из сети 6,6 млрд поддельных учётных записей. Но принципиально это ничего не меняет. Если в 2015 году меньше 7% аккаунтов были признаны фейками или дубликатами, то в прошлом году таких аккаунтов было уже 16%.

Ничего не мешает агентам влияния заводить новые аккаунты взамен удаленных, привязывать к "левым", т. е. обезличенным сим-картам и с помощью запрограммированных ботов оставлять соответствующие комментарии под постами на "горячие" темы, вызывать ссоры, переводить беседу в нужное русло, уводить от изначальной темы или просто сеять раздор.

Еще одна задача ботов в соцсетях и мессенджерах — распространение фейков. С этим также столкнулся практически каждый россиянин, у которого есть смартфон, в период самоизоляции в начале года. И думаю, еще не раз столкнется, пока тема коронавируса будет актуальной.

И все это совсем не безобидно. Например, власти уже нескольких стран обвиняют Facebook и Google в том, что их алгоритмы позволили третьим странам влиять на выбор граждан во время выборных кампаний кампаний и референдумов.

— Пытаются ли разработчики соцсетей и мессенджеров как-то устранить выявленную брешь в безопасности, оградить пользователей от негативного влияния?

— Попытки регулирования использования искусственного интеллекта в последнее время предпринимаются во многих странах. Если брать Россию, что с этого сентября у нас начали действовать два ГОСТа для ИИ, которые Росстандарт утвердил в прошлом году. А сейчас Росстандарт рассматривает план разработки стандартов в области искусственного интеллекта на 2021-2025 годы.

Но очевидно, что на текущий момент защита пользователей соцсетей находится в руках самих пользователей.

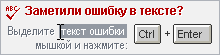

— Как же обычному пользователю определить: кто оставил негативный комментарий к его посту — человек или запрограммированный бот? И что ему делать, чтобы не попасть под бот-атаку?

— Давайте начнем с того, что большинство пользователей соцетей в погоне за социальным одобрением зачастую делает репосты по каким-то актуальным темам, поданных в скандальном или шокирующем ключе, не проверяя подлинность изложенной информации… чем уже играет на руку агентам влияния и попадается на удочку ботам, которые и разносят подобные фейки по сети. Отсюда первое правило: не уверен — не репость.

Далее — многим людям нравится видеть большое количество комментариев, под своими постами или теми же свежерепостнутыми фейками. Но посмотрите внимательно, кто и что пишет. Много "людей", которых вы видите первый раз в жизни, сами аккаунты заведены недавно, а комменты, с них оставленные, поданы в самой хамской манере — скорее всего с вами общается бот. Кстати, бывает еще вариант, что вас внезапно подписывают на какие-то сомнительные группы — это повод сразу забанить подписавшего вас "друга", велика вероятность, что сделал это ИИ.

В целом мой совет — относится к своему аккаунту в соцсетях, как к дому: не тащить непонятный мусор, который вполне может оказаться токсичным, и регулярно убираться, удаляя из друзей сомнительные аккаунты, словно выметаете из углов паутину вместе с пауками.

Надо наслаждаться жизнью — сделай это, подписавшись на одно из представительств Pravda. Ru в Telegram; Одноклассниках; ВКонтакте; News.Google.