Киберспецназ США готов начать пси-войну против россиян

Командование специальных операций США (SOCOM), стоящее за разработкой и осуществлением целого ряда "самых секретных военных интервенций", направило правительству страны запросы на проведение в Интернете пропагандистских кампаний и распространение дезинформации с помощью видеороликов с использованием технологии "дипфейк".

- "Дипфейк", или технология ультра-подделки, — это метод, использующий искусственный интеллект, который позволяет редактировать видео так, чтобы менять на нём одних людей на других.

Об этом со ссылкой на "официальные документы", сообщает сегодня издание The Intercept.

"В то время как американское правительство годами предупреждало об опасности, которую дипфейки представляют для демократических обществ, SOCOM намерен использовать эту весьма спорную технологию оскорбительным образом", — отмечает автор статьи.

Как следует из материала, планы командования спецоперациями включают взлом подключенных к Интернету устройств для подслушивания пользователей "с целью оценки восприимчивости иностранного населения к пропаганде":

"Это позволило бы разрабатывать и продвигать сообщения, которые местному населению было бы легче получать и в которые оно будет верить".

То есть, как только власти США "дадут добро" (а они его, несомненно, дадут, поскольку не раз говорили о намерении "победить любой ценой"), интернет-площадки наполнятся фейковыми "новостями", которые будет сложно отличить от настоящих.

Справедливости ради стоит отметить, что в самих США к новой "задумке" отнеслись весьма скептически.

"Когда дело доходит до дезинформации, Пентагон не должен бороться с огнём огнём", — заявил изданию Крис Мезерол, глава кафедры искусственного интеллекта и новых технологий Брукингского института, добавив, что использование "дипфейков" должно подлежать "проверке и надзору".

Вопрос лишь в том, кто будет осуществлять этот "надзор" и по каким критериям оценивать можно или нельзя запускать в работу тот или иной дипфейк?

Как работают "дипфейки"

Для того, чтобы понять, почему вдруг американское издание так сильно озадачилось "придумкой" SOCOM — ну в самом деле, мало ли фейков ежедневно обваливаются на головы пользователей интернета — я почитала профильные сайты. И, надо сказать, будучи человеком далёким от ИИ и новых технологий, поняла.

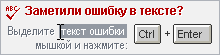

Посмотрите на фото:

Этих людей не существует. Они — результат работы программы. Согласитесь: сложно отличить сгенерированный образ от настоящего человека. На месте этих красивых молодых людей может оказаться изображение любого, к примеру, политика. Или военного. И этот "новый образ" оживёт — на видео он будет двигаться и говорить… Понятна задумка?

К слову, в России технологию дифейк уже начали использовать мошенники. Например, как рассказал в интервью России-24 зампред Сбербанка Станислав Кузнецов, бухгалтер одного из предприятий, поговорив с таким вот фейковым директором по видеосвязи, перевела по его поручению $100 тысяч неизвестно куда.

Кузнецов тогда подчеркнул, что Сбер уже запатентовал два способа распознавания дипфейков, которые "показали эффективность в 98%".

Но где технологии Сбера, а где рядовые пользователи интернета…

В общем, думается мне, стоит прислушаться к гендиректору компании "Нейросети Ашманова" Станиславу Ашманову и критически относиться ко всему, что вываливается из интернета:

"Вокруг нас скоро будет огромное количество контента, сгенерированного нейросетью. Нужно быть начеку и понимать, что видеоролики, тексты и картинки могут быть фейковыми, созданными машиной. Наступает эра автоматических дипфейков, это стало дешево и доступно".

Читайте также:

Умершего Владислава Галкина "оживили" ради продолжения сериала "Диверсант"

"Маразм крепчал": офис Зеленского обвинил Louis Vuitton в "кровавой" поддержке России

GR: дворцовый переворот, который готовили для Путина, случится в Киеве